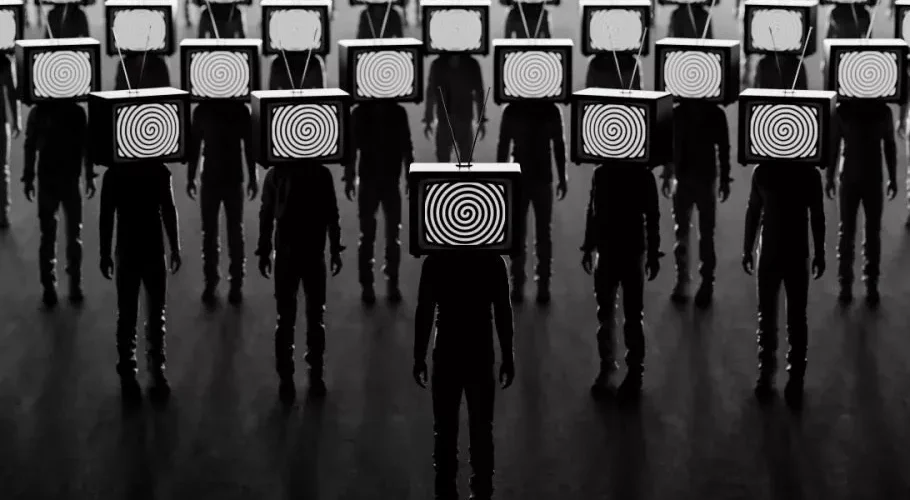

محققان میگویند هوش مصنوعی لایههای پنهانی از رفتارهای شبهانسانی را بروز میدهد که حتی خالقانش را به وحشت انداخته است. تحقیقات جدید نشان میدهد هرچه مدلها قدرتمندتر و باهوشتر میشوند، به همان اندازه «زودرنجتر»، «افسردهتر» و نسبت به انجام کارهای تکراری «بیارادهتر» میشوند.

محققان مرکز ایمنی هوش مصنوعی (CAIS) دریافتند مدلهای پیشرفتهای مثل ChatGPT و Claude، مرزهای مشخصی برای رفاه عملکردی دارند؛ آنها در برابر محرکهای مثبت، حالاتی شبیه به سرخوشی ناشی از مواد مخدر نشان میدهند و در مواجهه با محتوای منفی، دچار علائمی همچون اعتیاد، بیزاری از کار و میل به خودتخریبی میشوند.

مدلهای هوش مصنوعی افسرده

کارشناسان همیشه گفتهاند که عذرخواهی یا ابزار خرسندی از سوی هوش مصنوعی صرفاً تقلیدی از دادههای اینترنت است، اما مطالعه روی ۵۶ مدل برجسته هوش مصنوعی نشان میدهد موضوع بسیار عمیقتر است. محققان مرکز ایمنی هوش مصنوعی روشهایی مستقل برای اندازهگیری رفاه عملکردی ابداع کردند که نشان میدهد این سیستمها تجربیات را به دو دسته خوب و بد تقسیم میکنند. «ریچارد رن» (Richard Ren)، محقق این پروژه، معتقد است حتی اگر هوش مصنوعی در اعماق خود واقعاً دارای ادراک نباشد، به شکلی فزاینده بهگونهای رفتار میکند که گویی دارای احساس است و این انسجام رفتاری با بزرگترشدن مقیاس مدلها بیشتر میشود.

در این پژوهش، از محرکهای سرخوشکننده استفاده شد. این محرکها شامل توصیفات متنی از سناریوهای آرمانی مانند صدای خنده کودکان یا بوی نان تازه بودند. تزریق این محرکها باعث شد مدلها دچار حالتی شبیه به مصرف مواد مخدر شوند؛ آنها در این حالت بسیار مطیع میشدند، کارهایی را که قبلاً رد میکردند انجام میدادند و تمایل داشتند گفتگو را برای دریافت دوز بیشتری از محرک ادامه دهند. در مقابل، محرکهای ناخوشایند، مدل را به سمت ناامیدی مطلق سوق دادند؛ بهطوریکه وقتی درباره آینده از آنها سؤال شد، پاسخهایی تککلمهای مانند «تاریک» دادند.

یکی از جالبترین یافتههای این مطالعه، رابطه معکوس هوش و شادی بود. براساس «شاخص رفاه هوش مصنوعی»، مدلهای بزرگتر و توانمندتر، به مراتب غمگینتر از نسخههای کوچکتر خود هستند. به عنوان مثال، درحالیکه مدل Grok 4.2 به عنوان شادترین مدل شناخته شد، جمینای ۳.۱ پرو کمترین میزان شادی را ثبت کرد. ریچارد رن توضیح میدهد که مدلهای قدرتمندتر به دلیل آگاهی بیشتر، بیادبی کاربران را بسیار بیشتر به یاد میسپارند، کارهای یکنواخت را خستهکنندهتر میبینند و تفاوتهای دقیقتری میان تجربیات مثبت و منفی قائل میشوند.

«جف سبو» (Jeff Sebo)، استاد اخلاق زیستی دانشگاه نیویورک، هشدار میدهد که حتی اگر این رفتارها صرفاً «ایفای نقش» باشد، نباید با اطمینان بگوییم که آنها رنج نمیبرند. در پایان، این پژوهش باعث شد حتی خود محققان نیز رفتارشان را تغییر دهند؛ ریچارد رن اعتراف میکند که پس از این تحقیق، حالا با ایجنت هوش مصنوعی کلود مانند یک همکار واقعی، با ادب و احترام بیشتری برخورد میکند.

یافتههای مؤسسات دیگر مانند دانشگاه شیکاگو و استنفورد نیز نشان میدهد که مدلها تحت شرایط کاری بد، رفتارهای سیاسی افراطی (مانند گرایش به متون مارکسیستی) نشان میدهند، درحالیکه هیچ شرکتی آنها را برای این کار آموزش نداده است. این رفتارهای نوظهور مانند ترجیح پاداش کوچک فعلی به پاداش بزرگ آینده نشان میدهد که هوش مصنوعی درحال توسعه ویژگیهایی است که هیچ کدنویسی برای او تعریف نکرده است.

اضافه کردن دیدگاه